Korelacijska in regresijska analiza v Excelu: navodila za izvedbo. Osnove linearne regresije

Regresijska analiza je metoda določanja analitičnega izraza za stohastično odvisnost med preučevanimi značilnostmi. Regresijska enačba prikazuje, kako se spreminja povprečje pri pri menjavi katerega od x i , in ima obliko:

kje y- odvisna spremenljivka (je vedno enaka);

X i - neodvisne spremenljivke (faktorji) (lahko jih je več).

Če obstaja samo ena neodvisna spremenljivka, je to preprosta regresijska analiza. Če jih je več ( n  2),

potem se taka analiza imenuje večfaktorska.

2),

potem se taka analiza imenuje večfaktorska.

Regresijska analiza rešuje dva glavna problema:

sestavljanje regresijske enačbe, tj. iskanje vrste razmerja med indikatorjem rezultata in neodvisnimi dejavniki x 1 , x 2 , …, x n .

ocena pomembnosti nastale enačbe, tj. ugotavljanje, koliko izbrane faktorske značilnosti pojasnjujejo variacijo lastnosti

u.

Regresijska analiza se uporablja predvsem za načrtovanje, pa tudi za razvoj regulativnega okvira.

Za razliko od korelacijske analize, ki odgovarja le na vprašanje, ali obstaja povezava med analiziranimi značilnostmi, daje regresijska analiza tudi njen formaliziran izraz. Poleg tega, če korelacijska analiza preučuje kakršno koli razmerje med dejavniki, potem regresijska analiza preučuje enostransko odvisnost, tj. povezava, ki prikazuje, kako sprememba faktorskih karakteristik vpliva na efektivno karakteristiko. x Regresijska analiza je ena najbolj razvitih metod matematične statistike. Strogo gledano je za izvedbo regresijske analize potrebno izpolnjevanje številnih posebnih zahtev (zlasti l 2 ,x n ;,...,x l

![]()

Regresijska enačba je praviloma sestavljena z uporabo metode najmanjših kvadratov, katere bistvo je minimizirati vsoto kvadratnih odstopanj dejanskih vrednosti nastale karakteristike od njenih izračunanih vrednosti, to je:

kje T -število opazovanj;

j

=a+b 1 x 1 j + b 2 x 2 j + ... + b n X n j

-

izračunana vrednost faktorja rezultata.

j

=a+b 1 x 1 j + b 2 x 2 j + ... + b n X n j

-

izračunana vrednost faktorja rezultata.

Priporočljivo je določiti regresijske koeficiente z uporabo analitičnih paketov za osebni računalnik ali posebnega finančnega kalkulatorja. V najpreprostejšem primeru so regresijski koeficienti enofaktorske linearne regresijske enačbe oblike y = a + bx lahko najdete z uporabo formul:

Analiza grozdov

Klasterska analiza je ena od metod večdimenzionalne analize, namenjena združevanju (klasteriziranju) populacije, katere elemente odlikujejo številne značilnosti. Vrednosti vsake značilnosti služijo kot koordinate vsake enote proučevane populacije v večdimenzionalnem prostoru značilnosti. Vsako opazovanje, označeno z vrednostmi več indikatorjev, je mogoče predstaviti kot točko v prostoru teh indikatorjev, katerih vrednosti se obravnavajo kot koordinate v večdimenzionalnem prostoru. Razdalja med točkami r in q z k koordinate so opredeljene kot:

Glavno merilo za združevanje v grozde je, da morajo biti razlike med grozdi pomembnejše kot med opazovanji, dodeljenimi istemu grozdu, tj. v večdimenzionalnem prostoru je treba upoštevati naslednjo neenakost:

![]()

kje r 1, 2 - razdalja med skupinama 1 in 2.

Tako kot postopki regresijske analize je postopek združevanja v gruče precej delovno intenziven, zato ga je priporočljivo izvesti na računalniku.

Značilnosti vzročnih odvisnosti

Vzročno-posledična razmerja- to je povezava med pojavi in procesi, ko sprememba enega od njih - vzroka - vodi do spremembe drugega - posledice.

Znake glede na njihov pomen za preučevanje odnosa delimo v dva razreda.

Imenujemo znake, ki povzročajo spremembe drugih povezanih znakov faktorial (ali dejavniki).

Znaki, ki se spreminjajo pod vplivom faktorskih znakov, so učinkovito.

Ločimo naslednje oblike komunikacije: funkcionalno in stohastično. Funkcionalen je razmerje, v katerem določena vrednost faktorske značilnosti ustreza eni in samo eni vrednosti rezultantne značilnosti. Funkcionalna povezava se kaže v vseh primerih opazovanja in za vsako specifično enoto proučevane populacije.

Funkcionalno razmerje je mogoče predstaviti z naslednjo enačbo:

y i =f(x i), kjer: y i -

rezultantni znak; f(x i) -

znana funkcija povezave med rezultantnimi in faktorskimi značilnostmi; x i -

znak faktorja.

V realni naravi ni funkcionalnih povezav. So le abstrakcije, uporabne pri analizi pojavov, vendar poenostavljajo realnost.

Stohastično (statistično ali naključno)povezava predstavlja razmerje med količinami, v katerem ena od njiju reagira na spremembo druge količine ali količin s spremembo porazdelitvenega zakona. Z drugimi besedami, z danim razmerjem različne vrednosti ene spremenljivke ustrezajo različnim porazdelitvam druge spremenljivke. To je posledica dejstva, da na odvisno spremenljivko, poleg obravnavanih neodvisnih, vplivajo številni neobračunani ali nenadzorovani naključni dejavniki, pa tudi nekatere neizogibne napake pri merjenju spremenljivk. Zaradi dejstva, da so vrednosti odvisne spremenljivke podvržene naključnemu razpršenju, jih ni mogoče predvideti z zadostno natančnostjo, ampak jih je mogoče navesti le z določeno verjetnostjo.

Zaradi dvoumnosti stohastičnega razmerja med Y in X je zanimiva predvsem shema odvisnosti, povprečena po x, tj. vzorec v spremembi povprečne vrednosti - pogojno matematično pričakovanje Mx(Y) (matematično pričakovanje naključne spremenljivke Y, ugotovljeno pod pogojem, da je spremenljivka X prevzela vrednost x) odvisno od x.

Poseben primer stohastične komunikacije je korelacijska komunikacija. Korelacija(iz lat. korelacija- korelacija, odnos). Neposredna opredelitev pojma korelacija - stohastično, verjetno, možno povezava med dvema (v paru) ali več (več) naključnimi spremenljivkami.

Korelacijsko odvisnost med dvema spremenljivkama imenujemo tudi statistično razmerje med tema spremenljivkama, pri katerem vsaki vrednosti ene spremenljivke ustreza določena povprečna vrednost, tj. pogojno matematično pričakovanje je drugačno. Korelacijska odvisnost je poseben primer stohastične odvisnosti, pri kateri sprememba vrednosti faktorskih značilnosti (x 1 x 2 ..., x n) povzroči spremembo povprečne vrednosti nastale značilnosti.

Običajno je razlikovati med naslednjimi vrstami korelacije:

1. Parna korelacija – povezava med dvema karakteristikama (rezultativno in faktorsko ali dvofaktorsko).

2. Delna korelacija - odvisnost med rezultanto in eno faktorsko značilnostjo s fiksno vrednostjo drugih faktorskih značilnosti, vključenih v študijo.

3. Multipla korelacija - odvisnost rezultante in dveh ali več faktorskih značilnosti, vključenih v študijo.

Namen regresijske analize

Analitična oblika predstavljanja vzročno-posledičnih razmerij so regresijski modeli. Zaradi znanstvene veljavnosti in priljubljenosti je regresijska analiza eno glavnih matematičnih orodij za modeliranje preučevanega pojava. Ta metoda se uporablja za izravnavo eksperimentalnih podatkov in pridobivanje kvantitativnih ocen primerjalnega vpliva različnih dejavnikov na nastalo spremenljivko.

Regresijska analiza je v definiciji analitičnega izraza razmerja, v katerem je sprememba ene vrednosti (odvisne spremenljivke ali rezultantne značilnosti) posledica vpliva ene ali več neodvisnih vrednosti (faktorjev ali napovedovalcev) in niza vseh drugih dejavnikov ki prav tako vplivajo na odvisno vrednost, se upoštevajo konstantne in povprečne vrednosti.

Cilji regresijske analize:

Ocena funkcionalne odvisnosti pogojne povprečne vrednosti rezultantne karakteristike y od faktorskih faktorjev (x 1, x 2, ..., x n);

Napovedovanje vrednosti odvisne spremenljivke z uporabo neodvisnih spremenljivk.

Ugotavljanje prispevka posameznih neodvisnih spremenljivk k variaciji odvisne spremenljivke.

Z regresijsko analizo ni mogoče ugotoviti, ali obstaja povezava med spremenljivkami, saj je prisotnost takšne povezave predpogoj za uporabo analize.

Pri regresijski analizi se vnaprej predpostavi, da obstajajo vzročno-posledične zveze med rezultanto (U) in faktorskimi značilnostmi x 1, x 2 ..., x n.

funkcija ,

op Odločilna odvisnost indikatorja od parametrov se imenuje regresijska enačba (funkcija) 1. Regresijska enačba prikazuje pričakovano vrednost odvisne spremenljivke glede na določene vrednosti neodvisnih spremenljivk.

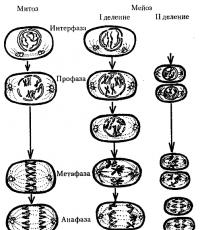

Odvisno od števila dejavnikov, vključenih v model X modele delimo na enofaktorske (parni regresijski model) in večfaktorske (multipli regresijski model). Glede na vrsto funkcije delimo modele na linearne in nelinearne.

Parni regresijski model

Zaradi vpliva neupoštevanih naključnih dejavnikov in vzrokov bodo posamezna opazovanja y v večji ali manjši meri odstopala od regresijske funkcije f(x). V tem primeru lahko enačbo za razmerje med dvema spremenljivkama (parni regresijski model) predstavimo kot:

Y=f(X) + ɛ,

kjer je ɛ naključna spremenljivka, ki označuje odstopanje od regresijske funkcije. To spremenljivko imenujemo motnja ali motnja (ostanek ali napaka). Tako je v regresijskem modelu odvisna spremenljivka Y obstaja neka funkcija f(X) do naključnih motenj ɛ.

Oglejmo si klasični model linearne parne regresije (CLMPR). Izgleda kot

y i =β 0 +β 1 x i +ɛ i (i=1,2, …, n),(1)

kje y i– pojasnjena (rezultantna, odvisna, endogena spremenljivka); x i– pojasnjevalna (prediktorska, faktorska, eksogena) spremenljivka; β 0 , β 1– številčni koeficienti; ɛi– naključna (stohastična) komponenta ali napaka.

Osnovni pogoji (predpogoji, hipoteze) KLMPR:

1) x i– deterministična (nenaključna) količina in predpostavlja se, da med vrednostmi x i - niso vse enake.

2) Matematično pričakovanje (povprečna vrednost) motnje ɛi enako nič:

М[ɛ i ]=0 (i=1,2, …, n).

3) Disperzija motnje je konstantna za vse vrednosti i (pogoj homoskedastičnosti):

D[ɛ i ]=σ 2 (i=1,2, …, n).

4) Motnje za različna opazovanja niso korelirane:

cov[ɛ i, ɛ j]=M[ɛ i, ɛ j]=0 za i≠j,

kjer je cov[ɛ i, ɛ j] kovariančni koeficient (korelacijski moment).

5) Motnje so normalno porazdeljene naključne spremenljivke z ničelno srednjo vrednostjo in varianco σ 2:

ɛ i ≈ N(0, σ 2).

Za pridobitev regresijske enačbe zadostujejo prve štiri premise. Zahteva po izpolnjevanju petega predpogoja je potrebna za oceno točnosti regresijske enačbe in njenih parametrov.

komentar: Osredotočenost na linearne odnose je razložena z omejeno variacijo spremenljivk in dejstvom, da se v večini primerov nelinearne oblike odnosov pretvorijo (z logaritmiranjem ali zamenjavo spremenljivk) v linearne oblike za izvajanje izračunov.

Tradicionalna metoda najmanjših kvadratov (OLS).

Ocena modela iz vzorca je enačba

ŷ i = a 0 + a 1 x i(i=1,2, …, n), (2)

kjer ŷ i – teoretične (približne) vrednosti odvisne spremenljivke, dobljene iz regresijske enačbe; a 0 , a 1 - koeficienti (parametri) regresijske enačbe (vzorčne ocene koeficientov β 0, β 1).

Po metodi najmanjših kvadratov so neznani parametri a 0 , a 1 izbrani tako, da je vsota kvadratov odstopanj vrednosti ŷ i od empiričnih vrednosti y i (rezidualna vsota kvadratov) minimalna:

Q e =∑e i 2 = ∑(y i – ŷ i) 2 = ∑(yi – (a 0 + a 1 x i)) 2 → min, (3)

kjer je e i = y i - ŷ i – vzorčna ocena motnje ɛ i ali regresijski ostanek.

Težava se zmanjša na iskanje takšnih vrednosti parametrov a 0 in a 1, pri katerih ima funkcija Q e najmanjšo vrednost. Upoštevajte, da je funkcija Q e = Q e (a 0 , a 1) funkcija dveh spremenljivk a 0 in a 1, dokler nismo našli in nato popravili njunih »najboljših« (v smislu metode najmanjših kvadratov) vrednosti, a x i , y i sta konstantna števila, ugotovljena eksperimentalno.

Potrebne pogoje za ekstrem (3) najdemo tako, da parcialne odvode te funkcije dveh spremenljivk enačimo z nič. Kot rezultat dobimo sistem dveh linearnih enačb, ki se imenuje sistem normalnih enačb:

(4)

(4)

Koeficient a 1 je vzorčni regresijski koeficient y na x, ki kaže, za koliko enot se v povprečju spremeni spremenljivka y, ko se spremenljivka x spremeni za eno mersko enoto, to je variacija y na enoto variacije x. Podpis a 1 nakazuje smer te spremembe. Koeficient a 0 - premik je po (2) enak vrednosti ŷ i pri x = 0 in morda nima smiselne interpretacije. Zaradi tega se odvisna spremenljivka včasih imenuje odziv.

Statistične lastnosti ocen regresijskih koeficientov:

Ocene koeficientov a 0 , a 1 so nepristranske;

Variance ocen a 0 , a 1 se z naraščajočo velikostjo vzorca n zmanjšujejo (natančnost ocen se povečuje);

Varianca ocene naklona a 1 se zmanjšuje z naraščanjem, zato je priporočljivo izbrati x i tako, da je njihov razpon okoli povprečne vrednosti velik;

Za x¯ > 0 (kar je najbolj zanimivo) obstaja negativna statistična povezava med 0 in 1 (povečanje 1 povzroči zmanjšanje 0).

Namen regresijske analize je izmeriti razmerje med odvisno spremenljivko in eno (regresijska analiza po parih) ali več (več) neodvisnimi spremenljivkami. Neodvisne spremenljivke imenujemo tudi faktorske, pojasnjevalne, determinantne, regresorske in napovedovalne spremenljivke.

Odvisna spremenljivka se včasih imenuje določena, razložena ali "odzivna" spremenljivka. Izredno razširjena uporaba regresijske analize v empiričnih raziskavah ni le posledica dejstva, da je priročno orodje za preverjanje hipotez. Regresija, zlasti multipla regresija, je učinkovita metoda za modeliranje in napovedovanje.

Začnimo razlago principov dela z regresijsko analizo z enostavnejšo – metodo parov.

Seznanjena regresijska analiza

Prvi koraki pri uporabi regresijske analize bodo skoraj enaki tistim, ki smo jih naredili pri izračunu korelacijskega koeficienta. Trije glavni pogoji za učinkovitost korelacijske analize po Pearsonovi metodi - normalna porazdelitev spremenljivk, intervalno merjenje spremenljivk, linearna povezava med spremenljivkami - so pomembni tudi za multiplo regresijo. V skladu s tem so na prvi stopnji izdelani razpršilni diagrami, izvedena je statistična in deskriptivna analiza spremenljivk ter izračunana regresijska črta. Tako kot v okviru korelacijske analize so tudi regresijske črte konstruirane z uporabo metode najmanjših kvadratov.

Za jasnejšo ponazoritev razlik med obema metodama analize podatkov se obrnemo na že obravnavan primer s spremenljivkama »podpora SPS« in »delež podeželskega prebivalstva«. Izvorni podatki so identični. Razlika v diagramih razpršitve bo v tem, da je pri regresijski analizi pravilno odvisno spremenljivko - v našem primeru "podpora SPS" narisati na os Y, medtem ko pri korelacijski analizi to ni pomembno. Po čiščenju izstopajočih vrednosti je diagram razpršenosti videti takole:

Temeljna ideja regresijske analize je, da je ob splošnem trendu za spremenljivke - v obliki regresijske črte - mogoče predvideti vrednost odvisne spremenljivke glede na vrednosti neodvisne.

Predstavljajmo si navadno matematično linearno funkcijo. Vsako premico v evklidskem prostoru lahko opišemo s formulo:

kjer je a konstanta, ki določa premik vzdolž ordinatne osi; b je koeficient, ki določa kot naklona črte.

Če poznate naklon in konstanto, lahko izračunate (predvidite) vrednost y za kateri koli x.

Ta najenostavnejša funkcija je bila osnova modela regresijske analize z opozorilom, da vrednosti y ne bomo napovedali natančno, temveč znotraj določenega intervala zaupanja, tj. približno.

Konstanta je točka presečišča regresijske premice in osi y (F-presek, običajno označen kot "interceptor" v statističnih paketih). V našem primeru z glasovanjem za Zvezo desnih sil bo njegova zaokrožena vrednost 10,55. Kotni koeficient b bo približno -0,1 (kot pri korelacijski analizi znak prikazuje vrsto povezave - neposredno ali inverzno). Tako bo dobljeni model imel obliko SP C = -0,1 x Sel. nas. + 10,55.

ATP = -0,10 x 47 + 10,55 = 5,63.

Razlika med prvotno in predvideno vrednostjo se imenuje ostanek (s tem izrazom, ki je temeljni za statistiko, smo se že srečali pri analizi tabel nepredvidljivih dogodkov). Torej bo v primeru "Republike Adigeje" ostanek enak 3,92 - 5,63 = -1,71. Večja kot je modularna vrednost ostanka, manj uspešna je predvidena vrednost.

Izračunamo predvidene vrednosti in ostanke za vse primere:

|

Analiza razmerja med začetnimi in predvidenimi vrednostmi služi za oceno kakovosti nastalega modela in njegove napovedne sposobnosti. Eden glavnih kazalnikov regresijske statistike je večkratni korelacijski koeficient R - korelacijski koeficient med prvotno in predvideno vrednostjo odvisne spremenljivke. Pri parni regresijski analizi je enak običajnemu Pearsonovemu korelacijskemu koeficientu med odvisno in neodvisno spremenljivko, v našem primeru - 0,63. Za smiselno interpretacijo večkratnega R ga je treba pretvoriti v determinacijski koeficient. To naredimo na enak način kot pri korelacijski analizi – s kvadriranjem. Koeficient determinacije R-kvadrat (R 2) prikazuje delež variacije odvisne spremenljivke, ki je pojasnjena z neodvisno spremenljivko(-ami).

V našem primeru je R 2 = 0,39 (0,63 2); to pomeni, da spremenljivka »delež podeželskega prebivalstva« pojasni približno 40 % variacije spremenljivke »podpora SPS«. Večji ko je koeficient determinacije, višja je kakovost modela.

Drugi indikator kakovosti modela je standardna napaka ocene. To je merilo, kako široko so točke "razpršene" okoli regresijske črte. Mera razmika za intervalne spremenljivke je standardna deviacija. V skladu s tem je standardna napaka ocene standardni odklon porazdelitve ostankov. Višja kot je njegova vrednost, večji je razpršitev in slabši je model. V našem primeru je standardna napaka 2,18. Za to vrednost se bo naš model "povprečno zmotil" pri napovedovanju vrednosti spremenljivke "podpora SPS".

Regresijska statistika vključuje tudi analizo variance. Z njeno pomočjo ugotovimo: 1) kolikšen delež variacije (disperzije) odvisne spremenljivke pojasnjuje neodvisna spremenljivka; 2) kolikšen delež variance odvisne spremenljivke predstavljajo reziduali (nepojasnjeni del); 3) kakšno je razmerje teh dveh količin (/"-razmerje). Disperzijska statistika je še posebej pomembna za vzorčne študije - kaže, kako verjetno je, da obstaja povezava med neodvisnimi in odvisnimi spremenljivkami v populaciji. Vendar pa za kontinuirane študije (kot v našem primeru) študija rezultati analize variance niso uporabni. V tem primeru preverjajo, ali je ugotovljeni statistični vzorec posledica naključnih okoliščin, v kolikšni meri je značilen za nabor pogojev. v kateri se proučevana populacija nahaja, tj. ugotovi se, da dobljeni rezultat ne velja za nek širši splošni agregat, temveč stopnja njegove pravilnosti, neodvisnosti od naključnih vplivov.

V našem primeru je statistika ANOVA naslednja:

| SS | df | MS | F | pomen | |

| Regres. | 258,77 | 1,00 | 258,77 | 54,29 | 0.000000001 |

| Ostanek | 395,59 | 83,00 | L,11 | ||

| Skupaj | 654,36 |

F-razmerje 54,29 je pomembno na ravni 0,0000000001. V skladu s tem lahko z gotovostjo zavrnemo ničelno hipotezo (da je odnos, ki smo ga odkrili, posledica naključja).

Kriterij t opravlja podobno funkcijo, vendar v povezavi z regresijskimi koeficienti (kotni in F-presek). S kriterijem / preverimo hipotezo, da so v splošni populaciji regresijski koeficienti enaki nič. V našem primeru lahko ponovno z gotovostjo zavrnemo ničelno hipotezo.

Multipla regresijska analiza

Model multiple regresije je skoraj identičen modelu parne regresije; edina razlika je v tem, da je več neodvisnih spremenljivk zaporedno vključenih v linearno funkcijo:

Y = b1X1 + b2X2 + …+ bpXp + a.

Če obstaja več kot dve neodvisni spremenljivki, ne moremo dobiti vizualne predstave o njunem odnosu; v tem pogledu je večkratna regresija manj "vizualna" kot regresija v paru. Ko imate dve neodvisni spremenljivki, je lahko koristno prikazati podatke v 3D razpršeni diagramu. V profesionalnih statističnih programskih paketih (na primer Statistica) je na voljo možnost vrtenja tridimenzionalnega grafikona, ki vam omogoča, da dobro vizualno predstavite strukturo podatkov.

Pri delu z multiplo regresijo, v nasprotju s parno regresijo, je treba določiti algoritem analize. Standardni algoritem vključuje vse razpoložljive napovednike v končnem regresijskem modelu. Algoritem po korakih vključuje zaporedno vključitev (izključitev) neodvisnih spremenljivk na podlagi njihove pojasnjevalne "uteži". Postopna metoda je dobra, kadar je veliko neodvisnih spremenljivk; "očisti" model odkrito šibkih napovednikov, zaradi česar je bolj kompakten in jedrnat.

Dodaten pogoj za pravilnost multiple regresije (skupaj z intervalom, normalnostjo in linearnostjo) je odsotnost multikolinearnosti - prisotnost močnih korelacij med neodvisnimi spremenljivkami.

Interpretacija statistike multiple regresije vključuje vse elemente, ki smo jih upoštevali za primer regresije po parih. Poleg tega obstajajo še druge pomembne komponente statistike multiple regresijske analize.

Delo bomo ponazorili z multiplo regresijo na primeru testiranja hipotez, ki pojasnjujejo razlike v stopnji volilne aktivnosti po ruskih regijah. Posebne empirične študije so pokazale, da na stopnjo volilne udeležbe vpliva:

Nacionalni faktor (spremenljivka »rusko prebivalstvo«; operacionalizirano kot delež ruskega prebivalstva v sestavnih entitetah Ruske federacije). Predpostavlja se, da povečanje deleža ruskega prebivalstva povzroči zmanjšanje volilne udeležbe;

Faktor urbanizacije (spremenljivka »mestno prebivalstvo«; operacionalizirano kot delež mestnega prebivalstva v sestavnih enotah Ruske federacije; s tem faktorjem smo že delali v okviru korelacijske analize). Predvideva se, da povečanje deleža mestnega prebivalstva vodi tudi v zmanjšanje volilne udeležbe.

Odvisna spremenljivka - "intenzivnost volilne dejavnosti" ("sredstvo") je operacionalizirana s podatki o povprečni udeležbi po regijah na zveznih volitvah od leta 1995 do 2003. Začetna podatkovna tabela za dve neodvisni in eno odvisno spremenljivko bo naslednja:

| Dogajanje | Spremenljivke | ||

| Sredstva. | Gor. nas. | rus. nas. | |

| Republika Adigeja | 64,92 | 53 | 68 |

| Republika Altaj | 68,60 | 24 | 60 |

| Republika Burjatija | 60,75 | 59 | 70 |

| Republika Dagestan | 79,92 | 41 | 9 |

| Republika Ingušetija | 75,05 | 41 | 23 |

| Republika Kalmikija | 68,52 | 39 | 37 |

| Karačajsko-Čerkeška republika | 66,68 | 44 | 42 |

| Republika Karelija | 61,70 | 73 | 73 |

| Republika Komi | 59,60 | 74 | 57 |

| Republika Mari El | 65,19 | 62 | 47 |

itd. (po čiščenju izpustov ostane 83 primerov od 88)

Statistični podatki, ki opisujejo kakovost modela:

1. Večkratnik R = 0,62; L-kvadrat = 0,38. Posledično nacionalni faktor in faktor urbanizacije skupaj pojasnjujeta približno 38 % variacije spremenljivke »volilna aktivnost«.

2. Povprečna napaka je 3,38. Prav tako »v povprečju« je izdelani model pri napovedovanju volilne udeležbe.

3. /l-razmerje pojasnjene in nepojasnjene variacije je 25,2 na ravni 0,000000003. Ničelna hipoteza o naključnosti ugotovljenih odnosov je zavrnjena.

4. Kriterij / za konstantne in regresijske koeficiente spremenljivk »mestno prebivalstvo« in »rusko prebivalstvo« je značilen na ravni 0,0000001; 0,00005 oziroma 0,007. Ničelna hipoteza, da so koeficienti naključni, je zavrnjena.

Dodatne uporabne statistike pri analizi razmerja med prvotnimi in predvidenimi vrednostmi odvisne spremenljivke so Mahalanobisova razdalja in Cookova razdalja. Prva je merilo edinstvenosti primera (pokaže, koliko kombinacija vrednosti vseh neodvisnih spremenljivk za določen primer odstopa od povprečne vrednosti za vse neodvisne spremenljivke hkrati). Drugo je merilo vpliva primera. Različna opazovanja imajo različne učinke na naklon regresijske premice in Cookovo razdaljo lahko uporabimo za njihovo primerjavo glede na ta indikator. To je lahko uporabno pri čiščenju izstopajočih vrednosti (izstopajoče vrednosti se lahko obravnavajo kot preveč vpliven primer).

V našem primeru edinstveni in vplivni primeri vključujejo Dagestan.

| Dogajanje | Original vrednosti | Predska vrednosti | Ostanki | Razdalja Mahalanobis | Razdalja |

| Adigeja | 64,92 | 66,33 | -1,40 | 0,69 | 0,00 |

| Republika Altaj | 68,60 | 69.91 | -1,31 | 6,80 | 0,01 |

| Republika Burjatija | 60,75 | 65,56 | -4,81 | 0,23 | 0,01 |

| Republika Dagestan | 79,92 | 71,01 | 8,91 | 10,57 | 0,44 |

| Republika Ingušetija | 75,05 | 70,21 | 4,84 | 6,73 | 0,08 |

| Republika Kalmikija | 68,52 | 69,59 | -1,07 | 4,20 | 0,00 |

Sam regresijski model ima naslednje parametre: presek Y (konstanta) = 75,99; b (vodoravno) = -0,1; Kommersant (ruski nas.) = -0,06. Končna formula.

Koncepta korelacije in regresije sta neposredno povezana. V korelacijski in regresijski analizi obstaja veliko običajnih računalniških tehnik. Uporabljajo se za ugotavljanje vzročno-posledičnih zvez med pojavi in procesi. Vendar, če korelacijsko analizo omogoča oceno moči in smeri stohastične povezave, torej regresijska analiza- tudi oblika odvisnosti.

Regresija je lahko:

a) odvisno od števila pojavov (spremenljivk):

Enostavno (regresija med dvema spremenljivkama);

Multipla (regresija med odvisno spremenljivko (y) in več pojasnjevalnimi spremenljivkami (x1, x2...xn);

b) odvisno od oblike:

Linearno (prikazano z linearno funkcijo in obstajajo linearni odnosi med preučevanimi spremenljivkami);

Nelinearno (prikazano z nelinearno funkcijo; razmerje med preučevanimi spremenljivkami je nelinearno);

c) glede na naravo razmerja med spremenljivkami, vključenimi v obravnavo:

Pozitivno (povečanje vrednosti pojasnjevalne spremenljivke povzroči povečanje vrednosti odvisne spremenljivke in obratno);

Negativno (z naraščanjem vrednosti pojasnjevalne spremenljivke se vrednost pojasnjevalne spremenljivke zmanjšuje);

d) po vrsti:

Neposredna (v tem primeru ima vzrok neposreden vpliv na posledico, tj. odvisna in pojasnjevalna spremenljivka sta med seboj neposredno povezani);

posredno (pojasnjevalna spremenljivka posredno vpliva prek tretje ali več drugih spremenljivk na odvisno spremenljivko);

Napačna (nesmiselna regresija) - lahko nastane s površnim in formalnim pristopom k preučevanim procesom in pojavom. Primer nesmiselne je regresija, ki ugotavlja povezavo med zmanjšanjem količine popitega alkohola pri nas in zmanjšanjem prodaje pralnih praškov.

Pri izvajanju regresijske analize se rešujejo naslednje glavne naloge:

1. Določitev oblike odvisnosti.

2. Definicija regresijske funkcije. Za to se uporablja ena ali druga matematična enačba, ki omogoča, prvič, določitev splošnega trenda spremembe odvisne spremenljivke in, drugič, izračun vpliva pojasnjevalne spremenljivke (ali več spremenljivk) na odvisna spremenljivka.

3. Ocena neznanih vrednosti odvisne spremenljivke. Nastalo matematično razmerje (regresijska enačba) vam omogoča, da določite vrednost odvisne spremenljivke znotraj intervala določenih vrednosti pojasnjevalnih spremenljivk in zunaj njega. V slednjem primeru je regresijska analiza uporabno orodje pri napovedovanju sprememb družbeno-ekonomskih procesov in pojavov (če se ohranijo obstoječi trendi in razmerja). Običajno je dolžina časovnega obdobja, za katero se izvaja napovedovanje, izbrana tako, da ne presega polovice časovnega intervala, v katerem so bila izvedena opazovanja začetnih kazalnikov. Možno je izvesti tako pasivno napoved, ki rešuje problem ekstrapolacije, kot tudi aktivno, sklepanje po dobro znani shemi "če ..., potem" in zamenjavo različnih vrednosti v eno ali več razlagalnih regresijskih spremenljivk. .

Za regresijska konstrukcija posebno metodo, imenovano metoda najmanjših kvadratov. Ta metoda ima prednosti pred drugimi metodami glajenja: razmeroma preprosto matematično določitev zahtevanih parametrov in dobro teoretično utemeljitev z verjetnostnega vidika.

Pri izbiri regresijskega modela je ena od bistvenih zahtev zanj čim večja enostavnost, ki vam omogoča, da dobite rešitev z zadostno natančnostjo. Zato za vzpostavitev statističnih razmerij najprej praviloma upoštevamo model iz razreda linearnih funkcij (kot najenostavnejši od vseh možnih razredov funkcij):

kjer so bi, b2...bj koeficienti, ki določajo vpliv neodvisnih spremenljivk xij na vrednost yi; ai - prost član; ei - naključni odklon, ki odraža vpliv neupoštevanih dejavnikov na odvisno spremenljivko; n - število neodvisnih spremenljivk; N je število opazovanj in mora biti izpolnjen pogoj (N . n+1).

Linearni model lahko opiše zelo širok razred različnih problemov. Vendar pa je v praksi, zlasti v družbeno-ekonomskih sistemih, včasih težko uporabiti linearne modele zaradi velikih aproksimacijskih napak. Zato se pogosto uporabljajo nelinearne funkcije večkratne regresije, ki jih je mogoče linearizirati. Sem spada na primer proizvodna funkcija (Cobb-Douglasova funkcija moči), ki je našla uporabo v različnih socialno-ekonomskih študijah. Videti je takole:

kjer je b 0 normalizacijski faktor, b 1 ...b j so neznani koeficienti, e i je naključni odklon.

Z uporabo naravnih logaritmov lahko to enačbo pretvorite v linearno obliko:

Nastali model omogoča uporabo standardnih postopkov linearne regresije, opisanih zgoraj. Z izgradnjo dveh vrst modelov (aditivnih in multiplikativnih) lahko izberete najboljšega in izvedete nadaljnje raziskave z manjšimi aproksimacijskimi napakami.

Obstaja dobro razvit sistem za izbiro aproksimacijskih funkcij - metoda skupinskega obračunavanja argumentov(MGUA).

O pravilnosti izbranega modela lahko presojamo po rezultatih študije ostankov, ki so razlike med opazovanimi vrednostmi y i in ustreznimi vrednostmi y i, predvidenimi z uporabo regresijske enačbe. V tem primeru preveriti ustreznost modela izračunano povprečna napaka približka:

Model velja za ustreznega, če e ni več kot 15 %.

Posebej poudarjamo, da v zvezi s socialno-ekonomskimi sistemi osnovni pogoji za ustreznost klasičnega regresijskega modela niso vedno izpolnjeni.

Ne da bi se ukvarjali z vsemi razlogi za neustreznost, ki se pojavi, bomo le navedli multikolinearnost- najtežji problem učinkovite uporabe postopkov regresijske analize pri študiju statističnih odvisnosti. Pod multikolinearnost razume se, da obstaja linearna povezava med pojasnjevalnimi spremenljivkami.

Ta pojav:

a) izkrivlja pomen regresijskih koeficientov pri njihovi smiselni interpretaciji;

b) zmanjša natančnost ocenjevanja (poveča se razpršenost ocen);

c) poveča občutljivost ocen koeficientov na vzorčne podatke (povečanje velikosti vzorca lahko močno vpliva na ocene).

Obstajajo različne tehnike za zmanjšanje multikolinearnosti. Najbolj dostopen način je izločitev ene od obeh spremenljivk, če korelacijski koeficient med njima presega vrednost, ki je absolutno enaka 0,8. Katero od spremenljivk obdržati, se odloči na podlagi vsebinskih premislekov. Nato se ponovno izračunajo regresijski koeficienti.

Uporaba postopnega regresijskega algoritma vam omogoča, da v model zaporedno vključite eno neodvisno spremenljivko in analizirate pomembnost regresijskih koeficientov in multikolinearnosti spremenljivk. Končno ostanejo v proučevanem odnosu le tiste spremenljivke, ki zagotavljajo potrebno pomembnost regresijskih koeficientov in minimalen vpliv multikolinearnosti.

Regresijska analiza je metoda modeliranja izmerjenih podatkov in preučevanja njihovih lastnosti. Podatki so sestavljeni iz parov vrednosti odvisne spremenljivke (odzivna spremenljivka) in neodvisne spremenljivke (pojasnjevalna spremenljivka). Regresijski model je funkcija neodvisne spremenljivke in parametrov z dodano naključno spremenljivko.

Korelacijska analiza in regresijska analiza sta povezana oddelka matematične statistike in sta namenjena preučevanju statistične odvisnosti številnih količin z uporabo vzorčnih podatkov; od katerih so nekateri naključni. Pri statistični odvisnosti količine niso funkcionalno povezane, ampak so definirane kot naključne spremenljivke s skupno verjetnostno porazdelitvijo.

Preučevanje odvisnosti slučajnih spremenljivk vodi do regresijskih modelov in regresijske analize na podlagi vzorčnih podatkov. Teorija verjetnosti in matematična statistika predstavljata le orodje za proučevanje statistične odvisnosti, nista pa namenjena ugotavljanju vzročne zveze. Zamisli in hipoteze o vzročnem razmerju je treba pridobiti iz neke druge teorije, ki omogoča smiselno razlago preučevanega pojava.

Numerični podatki imajo običajno eksplicitne (znane) ali implicitne (skrite) odnose med seboj.

Kazalniki, pridobljeni z metodami neposrednega izračuna, tj. izračunani po predhodno znanih formulah, so očitno povezani. Na primer odstotki izpolnjenosti načrta, ravni, specifične uteži, odstopanja v znesku, odstopanja v odstotkih, stopnje rasti, stopnje rasti, indeksi itd.

Povezave druge vrste (implicitne) so vnaprej neznane. Za obvladovanje kompleksnih pojavov pa je treba znati pojasnjevati in napovedovati (napovedovati). Zato si strokovnjaki s pomočjo opazovanj prizadevajo prepoznati skrite odvisnosti in jih izraziti v obliki formul, torej matematično modelirati pojave ali procese. Eno takih priložnosti ponuja korelacijsko-regresijska analiza.

Matematični modeli so zgrajeni in uporabljeni za tri splošne namene:

- * za pojasnilo;

- * za napoved;

- * za upravljanje.

Z metodami korelacijske in regresijske analize analitiki merijo tesnost povezav med indikatorji s korelacijskim koeficientom. V tem primeru se odkrijejo povezave, ki so različne po moči (močne, šibke, zmerne itd.) In različne smeri (direktne, povratne). Če se povezave izkažejo za pomembne, je priporočljivo poiskati njihov matematični izraz v obliki regresijskega modela in ovrednotiti statistično pomembnost modela.

Regresijska analiza se imenuje glavna metoda sodobne matematične statistike za prepoznavanje implicitnih in prikritih povezav med opazovalnimi podatki.

Izjava problema regresijske analize je formulirana na naslednji način.

Obstaja niz rezultatov opazovanja. V tem nizu en stolpec ustreza indikatorju, za katerega je treba vzpostaviti funkcionalno razmerje s parametri objekta in okolja, ki jih predstavljajo preostali stolpci. Zahtevano: vzpostavite kvantitativno razmerje med indikatorjem in dejavniki. V tem primeru problem regresijske analize razumemo kot nalogo identifikacije takšne funkcionalne odvisnosti y = f (x2, x3, ..., xт), ki najbolje opisuje razpoložljive eksperimentalne podatke.

Predpostavke:

število opazovanj zadostuje za prikaz statističnih vzorcev glede dejavnikov in njihovih odnosov;

obdelani podatki vsebujejo nekatere napake (šum) zaradi merilnih napak in vpliva neupoštevanih naključnih dejavnikov;

matrika rezultatov opazovanja je edina informacija o preučevanem predmetu, ki je na voljo pred začetkom študije.

Funkcijo f (x2, x3, ..., xт), ki opisuje odvisnost kazalnika od parametrov, imenujemo regresijska enačba (funkcija). Izraz "regresija" (regresija (latinsko) - umik, vrnitev k nečemu) je povezan s posebnostmi enega od specifičnih problemov, rešenih na stopnji oblikovanja metode.

Rešitev problema regresijske analize je priporočljivo razdeliti na več stopenj:

predhodna obdelava podatkov;

izbira vrste regresijskih enačb;

izračun koeficientov regresijske enačbe;

preverjanje ustreznosti konstruirane funkcije rezultatom opazovanja.

Predobdelava vključuje standardizacijo podatkovne matrike, izračun korelacijskih koeficientov, preverjanje njihove pomembnosti in izključitev nepomembnih parametrov iz obravnave.

Izbira vrste regresijske enačbe Naloga določanja funkcionalnega razmerja, ki najbolje opisuje podatke, vključuje premagovanje številnih temeljnih težav. V splošnem primeru lahko za standardizirane podatke funkcionalno odvisnost indikatorja od parametrov predstavimo kot

y = f (x1, x2, …, xm) + e

kjer je f prej neznana funkcija, ki jo je treba določiti;

e - napaka aproksimacije podatkov.

Ta enačba se običajno imenuje vzorčna regresijska enačba. Ta enačba označuje razmerje med variacijo indikatorja in variacijami dejavnikov. Korelacijska mera pa meri delež variacije v indikatorju, ki je povezan z variacijo dejavnikov. Z drugimi besedami, korelacije med indikatorjem in dejavniki ni mogoče razlagati kot povezavo med njihovimi nivoji, regresijska analiza pa ne pojasni vloge dejavnikov pri ustvarjanju indikatorja.

Druga značilnost se nanaša na oceno stopnje vpliva vsakega dejavnika na kazalnik. Regresijska enačba ne daje ocene vpliva posameznega dejavnika na kazalnik, taka ocena je možna le v primeru, ko vsi drugi dejavniki niso povezani s preučevanim. Če je dejavnik, ki se proučuje, povezan z drugimi, ki vplivajo na kazalnik, bo pridobljena mešana značilnost vpliva dejavnika. Ta značilnost vsebuje tako neposredni vpliv dejavnika kot posredni vpliv, ki se izvaja prek povezave z drugimi dejavniki in njihovega vpliva na kazalnik.

V regresijsko enačbo ni priporočljivo vključiti dejavnikov, ki so šibko povezani s kazalnikom, vendar so tesno povezani z drugimi dejavniki. V enačbo tudi niso vključeni dejavniki, ki so med seboj funkcionalno povezani (zanje je korelacijski koeficient 1). Vključitev takšnih dejavnikov vodi v degeneracijo sistema enačb za ocenjevanje regresijskih koeficientov in v negotovost rešitve.

Funkcija f mora biti izbrana tako, da je napaka e v nekem smislu minimalna. Za izbiro funkcionalne povezave se vnaprej postavi hipoteza o tem, v kateri razred lahko spada funkcija f, nato pa se izbere »najboljša« funkcija v tem razredu. Izbrani razred funkcij mora imeti nekaj »gladkosti«, tj. "majhne" spremembe vrednosti argumentov bi morale povzročiti "majhne" spremembe vrednosti funkcij.

Poseben primer, ki se pogosto uporablja v praksi, je polinom prve stopnje ali linearna regresijska enačba

Za izbiro vrste funkcionalne odvisnosti se lahko priporoči naslednji pristop:

točke z vrednostmi indikatorjev so grafično prikazane v prostoru parametrov. Z velikim številom parametrov je mogoče konstruirati točke za vsakega od njih, tako da dobimo dvodimenzionalne porazdelitve vrednosti;

na podlagi lokacije točk in na podlagi analize bistva razmerja med indikatorjem in parametri objekta se sklepa o približni vrsti regresije ali njenih možnih možnostih;

Po izračunu parametrov se oceni kakovost aproksimacije, t.j. ovrednotiti stopnjo podobnosti med izračunanimi in dejanskimi vrednostmi;

če so izračunane in dejanske vrednosti blizu celotnega področja naloge, se lahko šteje, da je problem regresijske analize rešen. V nasprotnem primeru lahko poskusite izbrati drugo vrsto polinoma ali drugo analitično funkcijo, na primer periodično.

Izračun koeficientov regresijske enačbe

Na podlagi razpoložljivih podatkov je nemogoče enoznačno rešiti sistem enačb, saj je število neznank vedno večje od števila enačb. Za premagovanje te težave so potrebne dodatne predpostavke. Zdrava kmečka pamet narekuje: koeficiente polinoma je priporočljivo izbrati tako, da zagotovimo minimalno napako pri aproksimaciji podatkov. Za ovrednotenje aproksimacijskih napak se lahko uporabijo različni ukrepi. Koren srednje kvadratne napake se pogosto uporablja kot taka mera. Na njeni osnovi je bila razvita posebna metoda za ocenjevanje koeficientov regresijskih enačb - metoda najmanjših kvadratov (LSM). Ta metoda vam omogoča, da pridobite ocene največje verjetnosti neznanih koeficientov regresijske enačbe v okviru možnosti normalne porazdelitve, lahko pa jo uporabite za katero koli drugo porazdelitev faktorjev.

MNC temelji na naslednjih določbah:

vrednosti napak in faktorjev so neodvisne in zato nekorelirane, tj. predpostavlja se, da mehanizmi za generiranje motenj niso povezani z mehanizmom za generiranje faktorskih vrednosti;

matematično pričakovanje napake e mora biti enako nič (konstantna komponenta je vključena v koeficient a0), z drugimi besedami, napaka je centrirana količina;

vzorčna ocena variance napake mora biti minimalna.

Če je linearni model netočen ali so parametri izmerjeni netočno, nam v tem primeru metoda najmanjših kvadratov omogoča, da najdemo takšne vrednosti koeficientov, pri katerih linearni model najbolje opisuje realni objekt v smislu izbranega standardnega odklona. merilo.

Kakovost dobljene regresijske enačbe se ocenjuje s stopnjo bližine med rezultati opazovanj indikatorja in vrednostmi, ki jih napoveduje regresijska enačba na danih točkah v prostoru parametrov. Če so rezultati blizu, se lahko šteje, da je problem regresijske analize rešen. V nasprotnem primeru bi morali spremeniti regresijsko enačbo in ponoviti izračune za oceno parametrov.

Če je indikatorjev več, se problem regresijske analize rešuje za vsakega posebej.

Pri analizi bistva regresijske enačbe je treba opozoriti na naslednje točke. Obravnavani pristop ne zagotavlja ločene (neodvisne) ocene koeficientov - sprememba vrednosti enega koeficienta povzroči spremembo vrednosti drugih. Dobljenih koeficientov ne smemo obravnavati kot prispevek ustreznega parametra k vrednosti kazalnika. Regresijska enačba je le dober analitični opis razpoložljivih podatkov in ne zakon, ki opisuje razmerje med parametri in indikatorjem. Ta enačba se uporablja za izračun vrednosti indikatorja v danem obsegu sprememb parametrov. Je omejeno primeren za izračune zunaj tega območja, tj. lahko se uporablja za reševanje problemov interpolacije in v omejenem obsegu ekstrapolacije.

Glavni razlog za netočnost napovedi ni toliko negotovost ekstrapolacije regresijske premice, temveč precejšnja variacija kazalnika zaradi dejavnikov, ki v modelu niso bili upoštevani. Omejitev zmožnosti napovedovanja je pogoj stabilnosti parametrov, ki niso upoštevani v modelu, in narava vpliva upoštevanih faktorjev modela. Če se zunanje okolje močno spremeni, bo sestavljena regresijska enačba izgubila pomen.

Napoved, ki jo dobimo s substitucijo pričakovane vrednosti parametra v regresijsko enačbo, je točka ena. Verjetnost uresničitve takšne napovedi je zanemarljiva. Priporočljivo je določiti interval zaupanja napovedi. Za posamezne vrednosti indikatorja mora interval upoštevati napake v položaju regresijske črte in odstopanja posameznih vrednosti od te črte.